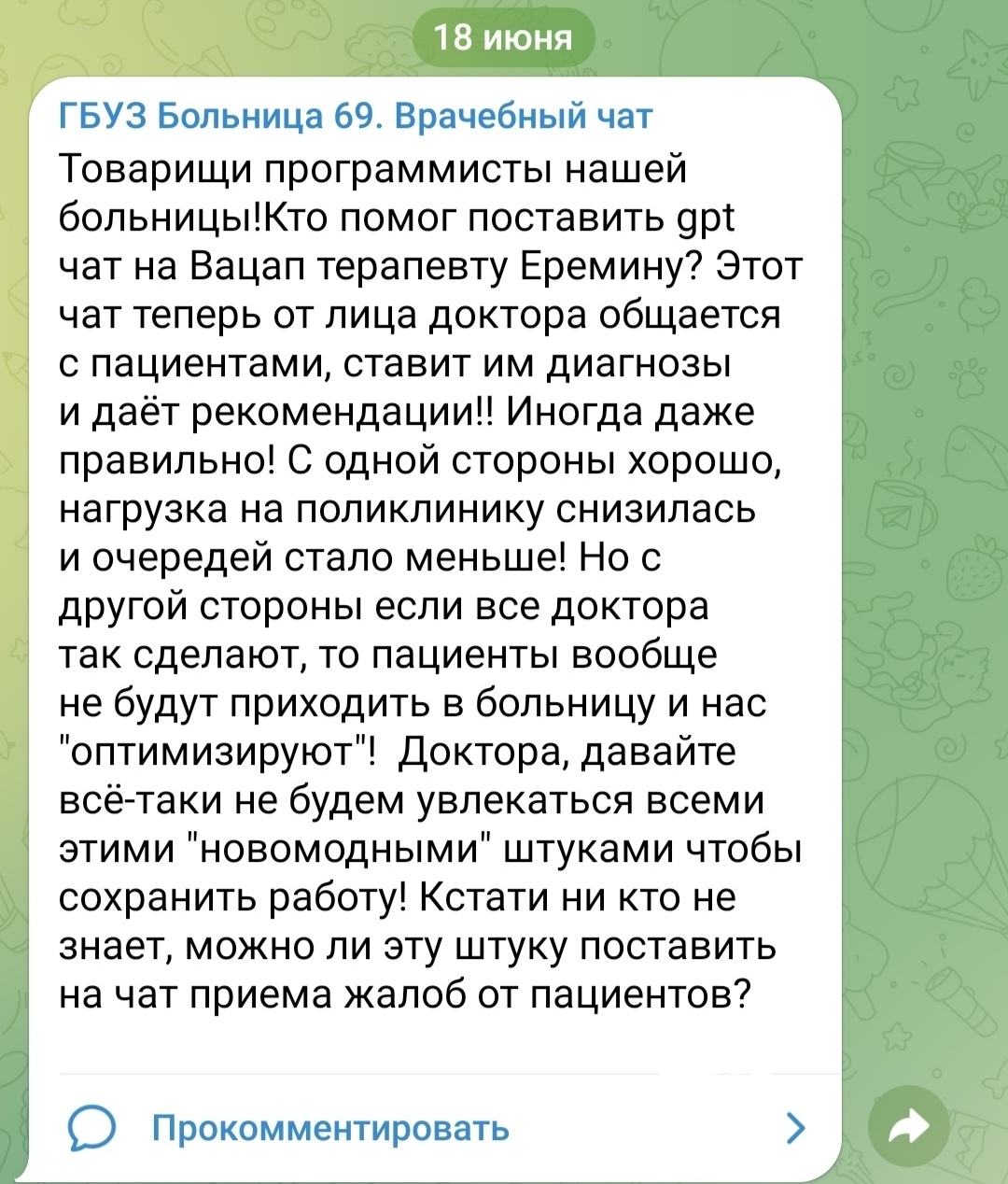

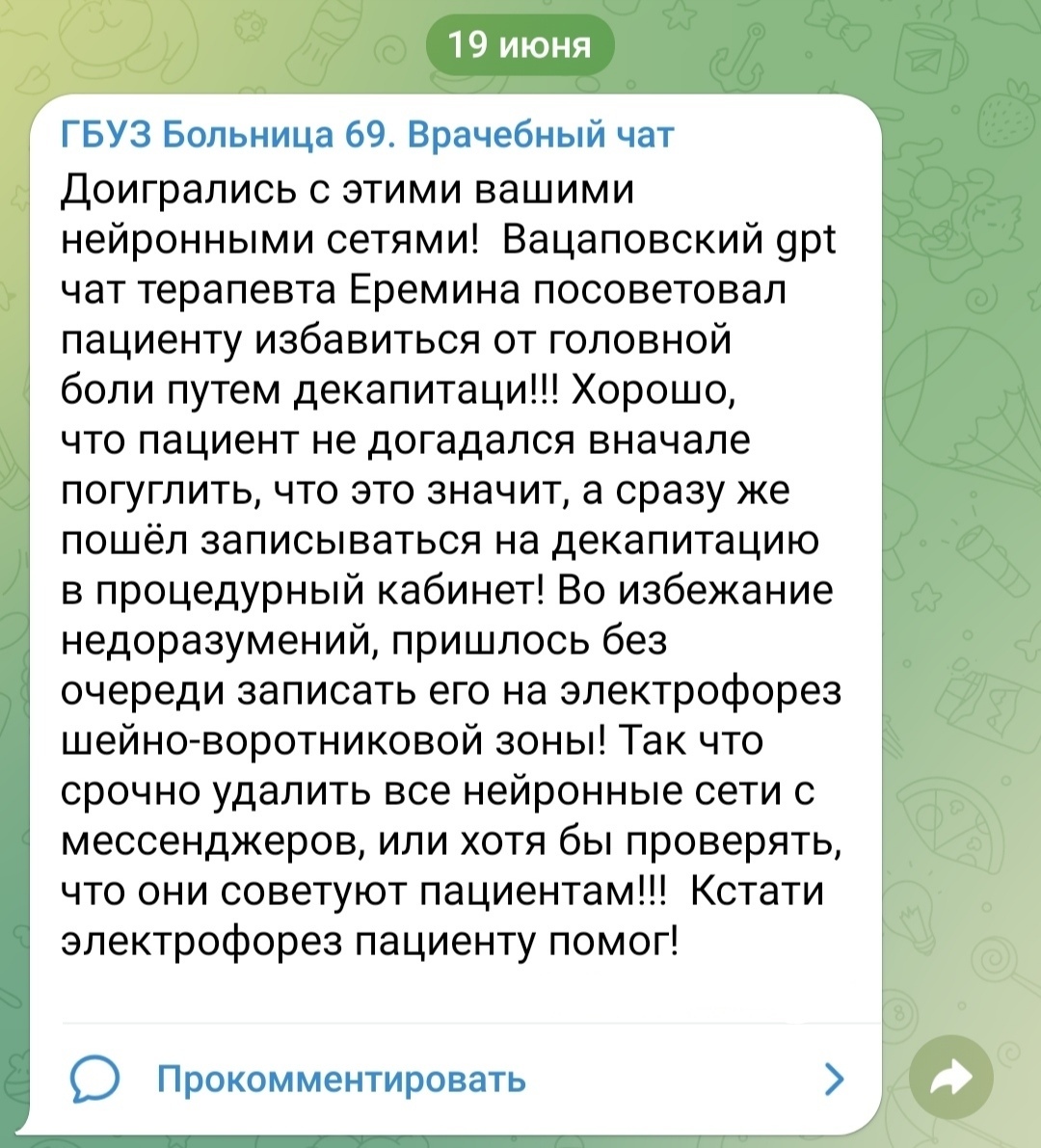

Российская нейросетевая модель GigaChat сдала экзамен на врача. Экзамен принимала комиссия из профессоров терапии, хирургии, акушерства и гинекологии Института медицинского образования НМИЦ им. В. А. Алмазова.Билет к устному экзамену состоял из трех задач разных областей медицины: терапии, хирургии, акушерства и гинекологии. GigaChat прошел тестирование, ответив на 82% вопросов, что превысило минимальный порог в 70%.

Директор Центра индустрии здоровья Сбера Сергей Жданов: «В перспективе модель может стать основой для создания помощника врача и пациента, обеспечить новые условия для заботы и знания о своем здоровье для каждого человека и стать существенным подспорьем для клинициста

===

Радует не только достижение, но и осторожность высказываний - в перспективе / может стать / основой для помощника.

Директор Центра индустрии здоровья Сбера Сергей Жданов: «В перспективе модель может стать основой для создания помощника врача и пациента, обеспечить новые условия для заботы и знания о своем здоровье для каждого человека и стать существенным подспорьем для клинициста

===

Радует не только достижение, но и осторожность высказываний - в перспективе / может стать / основой для помощника.